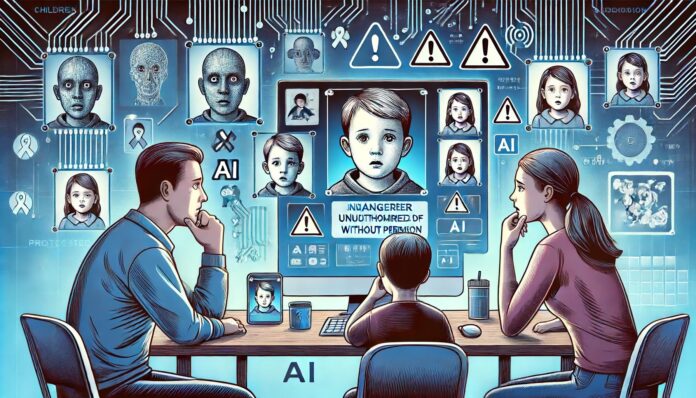

Un informe de Human Rights Watch ha revelado que fotografías de menores se han utilizado sin autorización para entrenar modelos de inteligencia artificial, como el generador de imágenes Stable Diffusion. En concreto, más de 170 fotos de niños brasileños fueron encontradas en el dataset LAION-5B, con algunos archivos incluyendo información personal detallada. Este uso indebido plantea serias preocupaciones sobre la privacidad y la seguridad de los menores.

Las imágenes de los menores, obtenidas sin el consentimiento de sus padres, no solo violan su privacidad, sino que también pueden ser manipuladas para crear deepfakes realistas. Esta manipulación expone a los niños a riesgos significativos, ya que estas imágenes pueden generar contenido falso y perjudicial, sin que los afectados sean conscientes de ello.

La recopilación de estas fotos proviene de blogs personales, sitios de fotografías y videos de YouTube con pocas visitas, revelando que incluso contenido destinado a un público reducido puede ser explotado para entrenar IA. El problema es más grande de lo que parece, ya que solo se revisó una fracción minúscula del dataset, sugiriendo que muchas más imágenes de menores podrían estar siendo usadas sin permiso.

Este caso subraya la necesidad urgente de implementar regulaciones estrictas para proteger a los menores en el entorno digital. Es crucial que padres, tutores y la sociedad en general comprendan los peligros de compartir fotos de niños en plataformas públicas. Además, es esencial que las autoridades garanticen el desarrollo ético y legal de la inteligencia artificial para proteger los derechos y la privacidad de los más vulnerables.

Fuente: Noticias IA