Los modelos de generación de música han emergido como herramientas revolucionarias que transforman texto de lenguaje natural en composiciones musicales. Originados a partir de avances en inteligencia artificial (IA) y aprendizaje profundo, estos modelos permiten que incluso aquellos sin formación musical formal puedan crear piezas de alta calidad mediante simples descripciones.

Actualmente, los modelos de IA generativa están cambiando la manera en que se crea y consume música. Empresas y creadores pueden utilizar esta tecnología para desarrollar nuevos productos, optimizar procesos y explorar potenciales inexplorados. La diversidad de aplicaciones incluye desde bandas sonoras personalizadas para multimedia y videojuegos, hasta herramientas educativas para estudiantes que investigan estilos y estructuras musicales. Además, estos modelos ofrecen nuevas ideas y composiciones a artistas y compositores, fomentando la creatividad y la colaboración.

Un destacado ejemplo de esta tecnología es AudioCraft MusicGen de Meta. Publicado bajo la licencia MIT y con los pesos del modelo bajo la licencia CC-BY-NC 4.0, MusicGen destina su funcionalidad a la creación de música basada tanto en texto como en entradas melódicas. Su capacidad para generar una variedad de géneros y estilos facilita una amplia gama de necesidades creativas. A diferencia de los métodos tradicionales que requieren múltiples modelos encadenados, MusicGen opera como un modelo único de lenguaje sobre varios flujos de representación musical comprimida discreta (tokens). Esta simplificación permite un control preciso sobre la generación musical, ofreciendo muestras mono y estéreo de alta calidad ajustadas a las preferencias del usuario.

Los usos de MusicGen son amplios, abarcando educación, creación de contenido y composición musical. Los estudiantes pueden experimentar con diferentes estilos, generar bandas sonoras personalizadas para proyectos y crear composiciones musicales únicas. Para músicos y compositores, MusicGen proporciona una herramienta innovadora para explorar nuevas ideas y fomentar la creatividad.

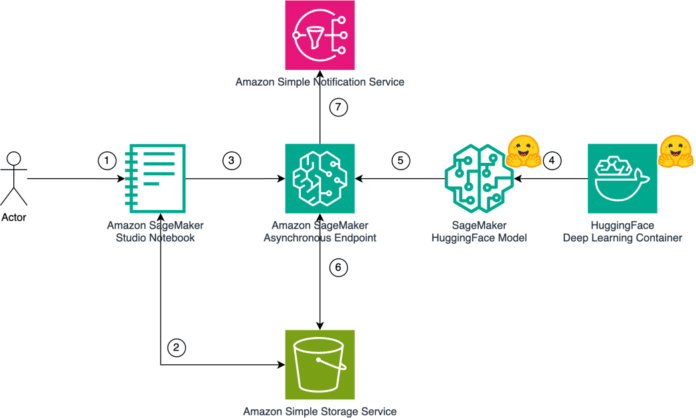

La implementación de MusicGen en Amazon SageMaker, utilizando inferencia asincrónica, presenta una solución eficaz para la generación de música. Este enfoque implica el despliegue de modelos de AudioCraft MusicGen desde el Hugging Face Model Hub en la infraestructura de SageMaker. Esta arquitectura permite a los usuarios generar música a partir de comandos de texto introducidos en lenguaje natural, gracias a los modelos desplegados en SageMaker.

El proceso de generación musical se configura desde la entrada del usuario hasta la salida musical, optimizando tanto la eficiencia como los recursos disponibles mediante la escalabilidad automática de las instancias de inferencia asincrónica de SageMaker.

Aquellos interesados en explorar estas capacidades pueden encontrar el código fuente completo y detalles adicionales en los repositorios oficiales de GitHub, proporcionando así una vía accesible y sofisticada para la innovación musical impulsada por IA.