Los modelos de lenguaje grandes (LLMs, por sus siglas en inglés) continúan demostrando su adaptabilidad al ser aplicados en diversas aplicaciones de procesamiento del lenguaje natural (NLP), desde diálogos básicos hasta tareas más complejas como la generación de resúmenes y la toma de decisiones. No obstante, las técnicas convencionales como la ingeniería de prompts y el ajuste fino supervisado frecuentemente resultan insuficientes para alinear estos modelos con las intenciones del usuario. Estas metodologías pueden provocar resultados no deseados, tales como la generación de respuestas incorrectas, contenido sesgado o tóxico, y respuestas de poca utilidad.

Ajustar modelos mediante el aprendizaje supervisado contribuye a mejorar su precisión, pero no abarca las complejidades éticas y sociales que son complicadas de incluir en ejemplos simples. Esto puede llevar a comportamientos no intencionados que se distancian del objetivo original al utilizar LLMs.

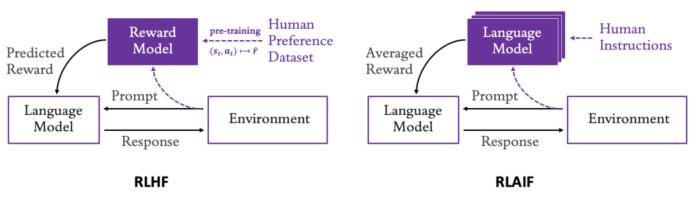

Una solución emergente es el uso de modelos de recompensa basados en feedback humano, lo que permite sintonizar los comportamientos de los modelos de lenguaje según las preferencias y valores humanos. Este método es conocido como entrenamiento por refuerzo con retroalimentación humana (RLHF, por sus siglas en inglés). Sin embargo, estudios recientes indican que la retroalimentación de otros modelos de IA podría ser una estrategia eficaz para escalar el desarrollo de modelos de recompensa, una técnica conocida como superalineación mediante retroalimentación de IA (RLAIF).

RLAIF capitaliza el uso de múltiples LLMs, cada uno especializado en una preferencia humana específica, como relevancia, concisión o toxicidad. Esto elimina la necesidad de servicios de anotación humana, aumentando la eficiencia del proceso. Esta técnica ha mostrado potencial en la creación de sistemas que son útiles, honestos y no perjudiciales, incluso cuando algunas capacidades de IA alcanzan o superan el desempeño humano.

Implementar RLAIF en casos concretos puede implicar la generación de respuestas a partir de un conjunto de datos de diálogos, con el objetivo de reducir la toxicidad de las respuestas. Para ello, se pueden emplear modelos de recompensa disponibles públicamente para afinar LLMs, evaluando posteriormente el éxito del ajuste con pruebas en un conjunto de datos separado.

El desarrollo y ajuste de modelos de lenguaje sigue siendo un campo dinámico y en constante evolución. Técnicas como RLAIF abren nuevas oportunidades para mejorar la alineación de la IA con las preferencias y valores humanos, garantizando respuestas más útiles y menos dañinas. La investigación constante en este ámbito es vital para enfrentar los desafíos éticos y técnicos que plantea la inteligencia artificial actual.