Las empresas están adoptando rápidamente modelos de lenguaje de gran escala (LLMs) a través de Amazon Bedrock, buscando extraer conclusiones de sus fuentes de datos internas. Este servicio totalmente gestionado ofrece modelos de alto rendimiento de destacados proveedores como AI21 Labs, Anthropic, Cohere, Meta y otros, mediante una única API. Además, Amazon Bedrock se enfoca en la inteligencia artificial generativa, garantizando seguridad, privacidad, y un enfoque responsable.

Un desafío común para las organizaciones que implementan inteligencia artificial conversacional es el tiempo de respuesta. Las APIs, aunque rápidas para resolver preguntas simples, enfrentan dificultades con consultas complejas que requieren lógica avanzada. Esto es crítico en industrias reguladas que exigen altos estándares de seguridad. Un ejemplo es una organización global de servicios financieros con más de 1.5 billones de dólares en activos bajo gestión, que busca mejorar la velocidad de respuesta sin comprometer la seguridad.

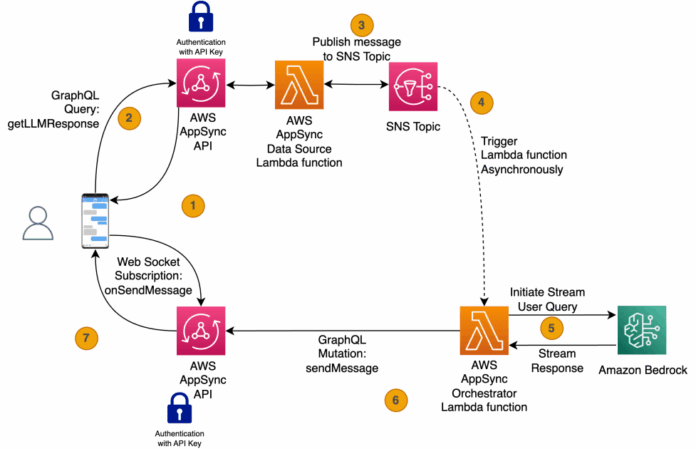

AWS AppSync se presenta como una solución efectiva a este problema. Es un servicio gestionado que permite construir APIs GraphQL con capacidades en tiempo real. Utiliza suscripciones junto con los puntos finales de streaming de Amazon Bedrock para entregar respuestas de los LLM de manera incremental, optimizando así la experiencia del usuario.

El sistema funciona asincrónicamente utilizando AWS AppSync para iniciar el flujo conversacional. Una función de AWS Lambda interactúa con la API de Amazon Bedrock, transmitiendo los tokens generados al front-end mediante mutaciones y suscripciones de AWS AppSync.

La arquitectura implica varios pasos: desde la suscripción de la aplicación a una conexión WebSocket, pasando por el envío de consultas mediante GraphQL, hasta la recepción de eventos en Amazon SNS. Posteriormente, una función Lambda procesa estos eventos, comunicándose con Amazon Bedrock para transmitir respuestas en tiempo real al usuario.

Al implementar esta solución, las organizaciones pueden optimizar significativamente los tiempos de respuesta en entornos empresariales. Un caso concreto en el sector financiero logró reducir los tiempos iniciales de respuesta para consultas complejas de alrededor de 10 segundos a entre 2 y 3 segundos, mejorando notablemente la interacción con los usuarios. Las empresas que integren esta estrategia podrán ver mejoras en la retención de clientes y el nivel de compromiso de los usuarios con sus aplicaciones, beneficiándose de tasas de abandono más bajas y una experiencia de usuario más satisfactoria.