Las operaciones de aprendizaje automático, conocidas como MLOps, están ganando relevancia en la industria tecnológica, con prácticas destinadas a automatizar y simplificar los flujos de trabajo y despliegues del aprendizaje automático (ML). A medida que estas operaciones se vuelven más complejas y su consumo de energía y recursos aumenta, las empresas están buscando estrategias para gestionar tanto los costos como la huella de carbono. AWS ha lanzado una guía para optimizar los MLOps con un enfoque en la sostenibilidad, ayudando a los clientes a maximizar la eficiencia y minimizar el desperdicio en sus cargas de ML.

El proceso completo de construcción, despliegue y uso de modelos de ML incluye principalmente tres flujos de trabajo: preparación de datos, entrenamiento y ajuste del modelo, y despliegue y gestión del modelo. La optimización comienza con la preparación de datos, una etapa crucial para el entrenamiento del modelo. Aquí, se pueden emplear las mejores prácticas de sostenibilidad de AWS, como la selección de una región con baja intensidad de carbono y el uso de arquitecturas sin servidor, para reducir el consumo de energía.

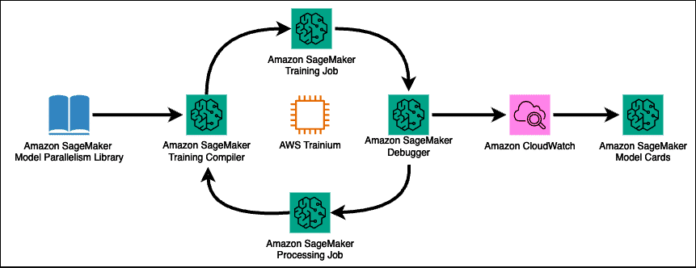

En la fase de entrenamiento y ajuste del modelo, la optimización no solo mejora la funcionalidad del modelo, sino también la eficiencia operativa. AWS SageMaker es una herramienta clave en esta fase, ofreciendo la biblioteca de modelos paralelos y el SageMaker Training Compiler para entrenar eficientemente modelos grandes. Además, la tecnología de ajuste automático de modelos (AMT) permite optimizar los hiperparámetros, reduciendo así el uso de recursos y la huella de carbono.

La última fase, despliegue y gestión de modelos, también presenta oportunidades de optimización. Utilizar herramientas como el Amazon SageMaker Model Registry y los endpoints multi-modelo puede mejorar la eficiencia y sostenibilidad al evitar la redundancia de recursos y permitir la reutilización de modelos. Asimismo, el escalado automático y los endpoints de inferencia asincrónicos ayudan a gestionar recursos de manera más eficiente durante los picos de carga, minimizando los recursos inactivos.

Integrar la sostenibilidad en cada etapa del diseño, desarrollo y despliegue de modelos de ML es crucial para el largo plazo. AWS está comprometido con la sostenibilidad en la nube y ofrece recursos como el SageMaker Model Monitor y el AWS Inferentia para ayudar a los clientes a transformar sus cargas de trabajo en operaciones más eficientes en términos de energía.

Estas prácticas no solo benefician al medio ambiente, sino que también mejoran la eficiencia operativa de las empresas. Revisar regularmente estas prácticas mediante herramientas como el AWS Well-Architected Machine Learning Lens puede identificar oportunidades de optimización y proporcionar una vía para alcanzar los objetivos de sostenibilidad organizacionales.