La implementación de sistemas de inteligencia artificial generativa como servicio (SaaS) ocupa un lugar central en la economía digital actual. Sin embargo, equilibrar la escalabilidad del servicio y la gestión de costos se presenta como un desafío, especialmente al diseñar un sistema generativo multi-inquilino que atienda una base de clientes diversa, manteniendo rigurosos controles y monitoreo del uso.

Las metodologías tradicionales para manejar costos en estos sistemas suelen enfrentar limitaciones. Los equipos de operaciones enfrentan dificultades para atribuir costos de manera precisa a cada inquilino, particularmente cuando los patrones de uso son extremadamente variables. Los clientes empresariales pueden mostrar comportamientos de consumo diferentes; algunos experimentan picos de uso repentinos durante períodos altos, mientras que otros mantienen patrones de consumo más estables.

Para enfrentar estos desafíos, se propone una solución robusta que incluye un sistema de alertas dinámico y contextualizado, superando los estándares de monitoreo convencionales. Implementar niveles de alerta graduados — del verde (operaciones normales) al rojo (intervenciones críticas) — permite desarrollar respuestas automáticas e inteligentes adaptadas a los patrones de uso cambiantes. Esto no solo previene sobrecostos sino que también facilita una gestión proactiva de los recursos y una asignación precisa de los costos.

El punto crítico suele llegar con los sobrecostos importantes. Estos no son resultado de un único factor, sino de la combinación de múltiples inquilinos que aumentan su uso sin que los sistemas de monitoreo identifiquen la tendencia a tiempo. Por lo tanto, los sistemas de alertas existentes, que usualmente ofrecen notificaciones binarias, pueden ser insuficientes, especialmente si se aplica un modelo de precios escalonados que varía según compromisos y cuotas de uso. Sin un sistema de alertas sofisticado capaz de diferenciar entre picos normales de uso y problemas reales, los equipos de operaciones podrían actuar de manera reactiva en lugar de proactiva.

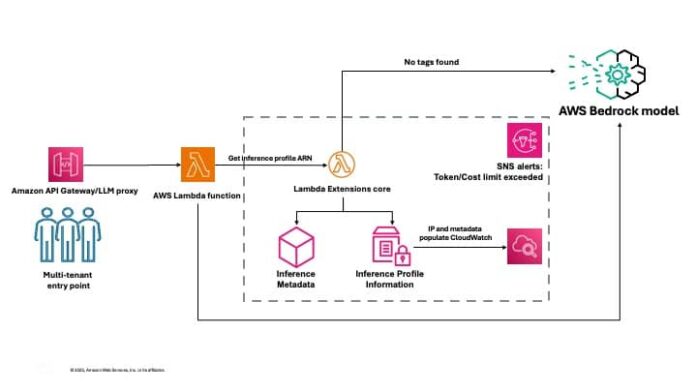

Para facilitar la gestión efectiva de costos en despliegues de IA generativa multi-inquilino, se ha desarrollado un enfoque basado en perfiles de inferencia de la aplicación Amazon Bedrock. Estos perfiles permiten un seguimiento detallado de costos asociando metadatos con cada solicitud de inferencia, creando una separación lógica entre aplicaciones o clientes que acceden a los modelos fundamentales. Empleando una estrategia de etiquetado consistente, es posible rastrear sistemáticamente qué inquilino es responsable de cada llamada a la API y su correspondiente consumo.

La arquitectura propuesta permite recolectar y agregar datos de uso de manera efectiva, almacenar métricas históricas para análisis de tendencias y presentar percepciones prácticas mediante paneles intuitivos. Este sistema de monitoreo brinda la visibilidad y el control necesarios para gestionar los costos asociados a Amazon Bedrock, ofreciendo personalización para ajustarse a las necesidades específicas de cada organización.

Implementar esta solución ayuda no solo a rastrear el uso de modelos, sino que también proporciona la capacidad de asignar costos con precisión y optimizar el consumo de recursos entre diferentes inquilinos. Realizar ajustes y desarrollos adicionales basados en la retroalimentación y patrones de uso observados permitirá alcanzar una administración más efectiva y eficiente de los recursos en el entorno de inteligencia artificial generativa.