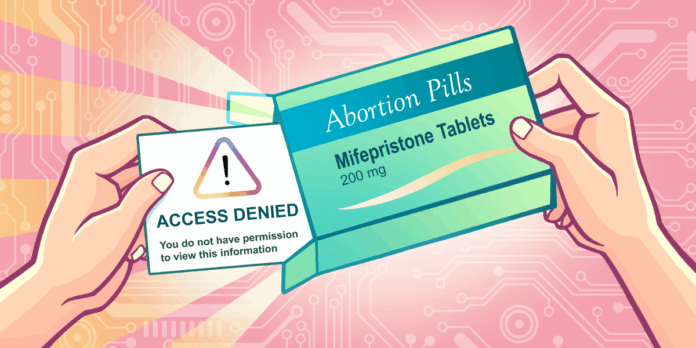

Una reciente iniciativa ha puesto de relieve los desafíos que enfrentan los usuarios al compartir contenido sobre atención reproductiva en plataformas como Instagram. El caso de Samantha Shoemaker ilustra esta situación. Shoemaker publicó material sobre el acceso a píldoras abortivas, incluyendo videos y recursos de organizaciones legítimas, que fue eliminado por supuestas violaciones a las políticas de Meta, la empresa matriz de Instagram.

Las reglas de Meta bajo su política de «Organizaciones e Individuos Peligrosos» se concibieron originalmente para combatir el extremismo en línea. Sin embargo, según la Electronic Frontier Foundation (EFF), su aplicación se ha extendido de manera alarmante, afectando principalmente a voces marginalizadas y generando críticas por su falta de transparencia.

Pese a que Meta ha realizado aclaraciones en su Centro de Transparencia, los problemas continúan. Shoemaker fue informada de que sus publicaciones, que eran de carácter informativo y factual sobre píldoras abortivas, violaban normativas destinadas a contener el extremismo violento. Este error en la moderación de contenido puede hacer que información médica esencial se confunda con actividades ilegales o peligrosas.

Este tema adquiere mayor relevancia ante la creciente amenaza contra el acceso a la información sobre el aborto debido a restricciones políticas. En este contexto, es crucial que las plataformas eviten silenciar discursos que son esenciales para la salud y el bienestar de muchas personas. Además, es fundamental que, si se elimina contenido, los usuarios reciban explicaciones claras y precisas sobre las razones de tales acciones.

Los usuarios que enfrenten la eliminación de su contenido tienen varias opciones. Pueden apelar la decisión directamente a través de la aplicación, pedir la revisión por parte de la Junta de Supervisión de Meta, documentar su caso y compartir su experiencia con proyectos que buscan visibilizar estas injusticias.

La EFF enfatiza que compartir información sobre salud reproductiva no es peligroso, sino necesario. Las plataformas deben garantizar el acceso a información crucial y proporcionar claridad sobre cómo moderan las publicaciones y cómo los usuarios pueden impugnar decisiones aparentemente injustas.