La inteligencia artificial generativa está revolucionando industrias globalmente, permitiendo a las empresas mejorar la experiencia del cliente, agilizar procesos y fomentar la innovación. Sin embargo, esta transformación tecnológica plantea preguntas cruciales sobre su uso responsable.

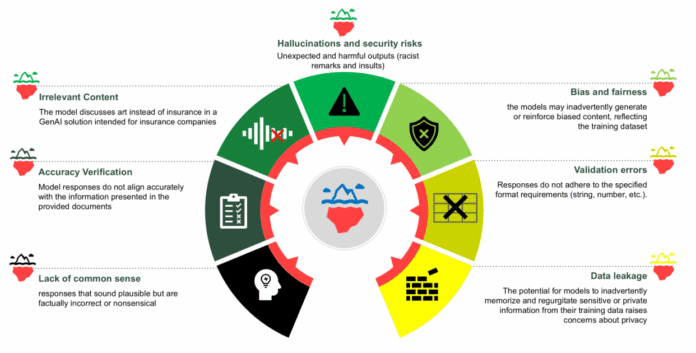

Dado el enfoque en la inteligencia artificial responsable durante la última década, los modelos generativos presentan desafíos únicos, como «alucinaciones» y riesgos de propiedad intelectual. Para maximizar su potencial y mitigar riesgos, es vital implementar técnicas de control durante su desarrollo.

Una metodología clave en este ámbito es el «red teaming», que simula condiciones adversas para evaluar sistemas. En la IA generativa, se someten modelos a pruebas rigurosas para detectar fallas y evaluar su resiliencia, desarrollando así sistemas más seguros y confiables. Integrar el red teaming en el desarrollo de IA permite a las organizaciones anticipar amenazas y fomentar la confianza en sus soluciones.

Los sistemas de IA generativa presentan desafíos de seguridad que requieren enfoques específicos. Riesgos como respuestas alucinadas o la divulgación de datos sensibles son preocupaciones latentes, potencialmente explotables por adversarios.

Data Reply, en colaboración con AWS, apoya la integración de técnicas de IA responsable y red teaming en flujos de trabajo organizacionales, mitigando riesgos y cumpliendo con regulaciones emergentes. Han desarrollado el Red Teaming Playground, un entorno de pruebas con herramientas de código abierto y servicios de AWS para evaluar modelos en condiciones adversas, mejorando su seguridad.

Un ejemplo destacado es un asistente de triaje de salud mental, que necesita manejar temas sensibles con cuidado. Definiendo casos de uso específicos y estableciendo expectativas de calidad, el modelo puede ser instruido para responder adecuadamente.

La continua mejora en políticas de IA responsable es esencial, y la colaboración entre Data Reply y AWS busca industrializar esfuerzos como verificaciones de equidad y pruebas de seguridad, ayudando a las organizaciones a enfrentar amenazas emergentes y estándares en evolución.