En los últimos años, el auge de los modelos de lenguaje de gran tamaño (LLMs) ha impulsado la adopción de la inteligencia artificial en diversas industrias. Sin embargo, para potenciar aún más estas capacidades y aprovechar información actualizada y conocimientos específicos, la integración con fuentes externas de datos se ha vuelto esencial. En este contexto, la Generación Aumentada por Recuperación (RAG) surge como una solución eficaz.

La técnica RAG se centra en buscar información relevante en bases de datos existentes y combinarla con las solicitudes del usuario para que el LLM genere respuestas precisas y contextualizadas. Esta metodología se aplica en numerosas aplicaciones, desde el desarrollo de productos hasta la atención al cliente, mejorando la toma de decisiones basada en datos actuales.

La implementación de RAG ofrece ventajas significativas a los proveedores de software como servicio (SaaS) y sus usuarios. Los proveedores pueden beneficiarse de una arquitectura multi-tenant que permite ofrecer servicios a múltiples clientes desde un único sistema. En este modelo, los datos de cada cliente están protegidos con estrictos controles de acceso y aislamiento. Al incorporar RAG, los servicios de IA pueden aprovechar datos específicos para proporcionar soluciones personalizadas.

Por ejemplo, en un centro de atención telefónica SaaS, los registros históricos y manuales de productos específicos de cada cliente se convierten en bases de conocimiento valiosas. Un sistema RAG puede utilizar estas fuentes para generar respuestas precisas y personalizadas, algo imposible con asistentes de IA genéricos. RAG, por tanto, se convierte en un componente crucial para ofrecer experiencias personalizadas, mejorando el valor y diferenciando el servicio.

No obstante, el uso de RAG conlleva desafíos de seguridad y privacidad. Es fundamental implementar arquitecturas que aseguren el aislamiento de datos y eviten la filtración accidental de información entre clientes. La implementación segura de datos es esencial para la confiabilidad de los servicios SaaS.

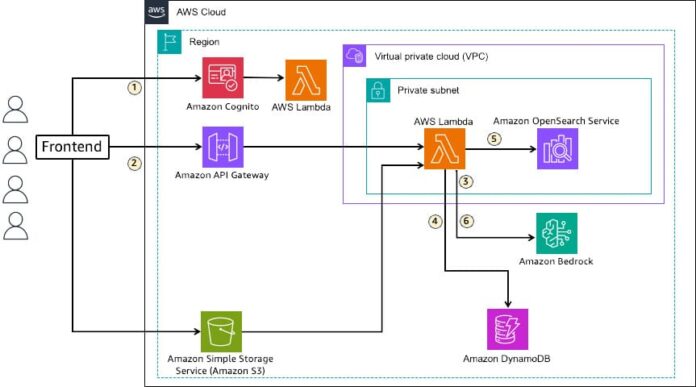

Para facilitar la implementación de RAG, Amazon Bedrock Knowledge Bases ofrece una solución robusta. Al integrar OpenSearch como base de datos vectorial, se presentan dos opciones: Amazon OpenSearch Service y Amazon OpenSearch Serverless, cada una con diferentes características de permisos para entornos multi-tenant. La combinación de JSON Web Token (JWT) y Control de Acceso Basado en Atributos (FGAC) se propone para gestionar eficazmente el acceso y el aislamiento de datos.

Esta solución emplea impuestos de base de datos y autenticación con JWT para garantizar la seguridad y el aislamiento en OpenSearch Service, permitiendo la búsqueda de información relevante a partir de consultas de usuario. Así, la información recuperada se incorpora al LLM, mejorando la precisión y relevancia de las respuestas generadas.

A medida que RAG gana terreno en el sector SaaS, los desafíos técnicos relacionados con la gestión de datos multi-tenant requieren soluciones innovadoras que aseguren la protección de la información sensible y maximicen la utilidad de los sistemas de IA. Esto supone un paso importante en la evolución del software y los servicios en la nube, donde la personalización y la seguridad son factores críticos.